Ленивый Сэм Альтман Нанимает Новый OpenAI

- Ленивый Сэм Альтман Нанимает Новый OpenAI

- Связанные вопросы и ответы

- Почему Сэм Альтман, известный своей ленью, решил нанять новый OpenAI

- Как новая версия OpenAI может повлиять на рынок искусственного интеллекта

- В чем заключаются основные различия между новым OpenAI и предыдущими версиями

- Как лень Сэма Альтмана отразится на стратегии развития OpenAI

- Каковы ожидания от новой команды, которую нанял Сэм Альтман

- Может ли лень быть полезной качеством для руководителя, как это видно на примере Сэма Альтмана

- Какие задачи стоят перед новой командой OpenAI под руководством Сэма Альтмана

Ленивый Сэм Альтман Нанимает Новый OpenAI

Альтман не человек с улицы и не просто так он стал сооснователем НКО вместе с Маском. До OpenAI у Альтмана был серьезный опыт в виде легендарного Y Combinator, а это означает, что этот человек отлично умеет делать деньги.Собственно, самой популярной и самой правильной версией увольнения Альтмана являются неразрешимые идеологические расхождения между политикой гендиректора коммерческой части OpenAI и остальной НКО под той же вывеской. Альтман, почувствовав запах больших денег и серьезного прорыва, сделал то, что умеет — рванул к Луне со своим проектом, оседлав по пути такого монстра, как Microsoft.Последней каплей трений между Альтманом и советом директоров той самой управляющей НКО стала последняя презентация, на которой была анонсирована возможности создания кастомных билдов GPT-4. Почему именно это?Вспомним, что идеологически основатели OpenAI были под стать Маску, который крайне критически в последнее время высказывался о проекте Альтмана. И хотя он вышел из совета еще в 2018 году, к его мнению прислушивались. Основные опасения руководства НКО состояли в том, что Сэм со своей гонкой за деньгами, породит

Связанные вопросы и ответы:

1. Кто такой Сэм Альтман и почему его называют ленивым в контексте OpenAI

Сэм Альтман — известный предприниматель и инвестор в сфере технологий, наиболее известный как бывший CEO компании Y Combinator. В контексте OpenAI его называют "ленивым" Сэмом из-за его подхода к управлению, который часто характеризуется как нестандартный и расслабленный. Он предпочитает делегировать полномочия своим командам, позволяя им принимать решения и реализовывать идеи без чрезмерного контроля. Это может восприниматься как лень, но на самом деле это стратегия, направленная на стимулирование креативности и инициативы внутри компании.

2. Какие цели Сэм Альтман преследовал, нанимая новый OpenAI

Сэм Альтман, нанимая новый OpenAI, преследовал несколько ключевых целей. Во-первых, он стремился привлечь в команду талантливых специалистов, которые могли бы внести вклад в развитие искусственного интеллекта. Во-вторых, он хотел создать более гибкую и адаптивную организацию, способную быстро реагировать на изменения в технологиях. В-третьих, его целью было обеспечение устойчивого роста и развития OpenAI, что требовало привлечения новых идей и подходов.

3. Какие изменения произошли в OpenAI после прихода Сэма Альтмана

После прихода Сэма Альтмана в OpenAI произошли значительные изменения. Одним из главных изменений стало введение более гибкой структуры управления, что позволило командам работать более автономно. Кроме того, Сэм поощрял культуру инноваций и экспериментов, что привело к разработке новых продуктов и технологий. Также он акцентировал внимание на прозрачности и открытости, что способствовало укреплению репутации компании.

4. Как "ленивость" Сэма Альтмана влияет на развитие искусственного интеллекта

"Ленивость" Сэма Альтмана, то есть его подход к делегированию и предоставлению свободы действий, положительно влияет на развитие искусственного интеллекта. Такой стиль управления позволяет специалистам сосредоточиться на решении сложных задач, стимулирует креативность и ускоряет процесс инноваций. Это приводит к более быстрому прогрессу в области ИИ и разработке новых технологий.

5. Какие вызовы столкнул Сэм Альтман, взявшись за новую роль в OpenAI

Сэм Альтман столкнулся с несколькими вызовами, взявшись за новую роль в OpenAI. Одним из основных было необходимость адаптации к новой роли и ответственности, что потребовало изменения его привычного стиля работы. Также он столкнулся с необходимостью балансировать между делегированием полномочий и сохранением контроля за ключевыми направлениями. Кроме того, ему пришлось решать задачи, связанные с привлечением и удержанием талантливых сотрудников.

6. В чем заключается вклад Сэма Альтмана в развитие OpenAI

Вклад Сэма Альтмана в развитие OpenAI заключается в его уникальном подходе к управлению, который стимулирует инновации и креативность внутри компании. Он также привлек в команду высококвалифицированных специалистов, что способствовало ускорению разработки новых технологий. Его акцент на прозрачности и открытости укрепил репутацию OpenAI и повысил доверие со стороны пользователей и партнеров.

7. Какие перспективы открывает новый OpenAI под руководством Сэма Альтмана

Под руководством Сэма Альтмана OpenAI имеет перспективы дальнейшего роста и развития. Компания может продолжить разработку передовых технологий искусственного интеллекта, что может привести к значительному прогрессу в различных областях, таких как медицина, образование и транспорт. Также можно ожидать расширения сотрудничества с другими компаниями и исследовательскими учреждениями, что еще больше ускорит инновации.

8. Как "ленивость" Сэма Альтмана может повлиять на будущее технологий

"Ленивость" Сэма Альтмана, то есть его подход к делегированию и предоставлению свободы действий, может оказать положительное влияние на будущее технологий. Такой стиль управления способствует созданию более гибких и адаптивных команд, что ускоряет процесс разработки новых технологий. Это может привести к более быстрому прогрессу в различных областях и появлению инновационных решений, которые будут формировать будущее технологий.

Почему Сэм Альтман, известный своей ленью, решил нанять новый OpenAI

После успешной продажи Loopt господин Альтман сосредоточился на деньгах. Он запустил венчурный фонд Hydrazine Capital — вдохновившись, очевидно, Y Combinator. В него Сэм вложил почти все деньги, полученные от продажи Loopt. Кроме того, в новое детище Сэма решил инвестировать Питер Тиль — один из основателей PayPal. В общей сложности в первом инвестраунде Hydrazine привлек $21 млн.

Выйти из полноэкранного режима

Развернуть на весь экран

Насколько предприятие успешно — сказать сложно. Фонд отчитываться не обязан, а сам Сэм Альтман тщательно оберегает информацию о своем благосостоянии. Единственное, что известно наверняка, это то, что у него есть в личном владении несколько спорткаров и особняк в Сан-Франциско стоимостью $27 млн, расположенный на Рашен-Хилл (Русской Горке).

Еще несколько лет назад Сэм Альтман говорил, что стоимость фонда выросла к концу 2016 года в десять раз по сравнению с изначальной оценкой. Но во сколько конкретно оценивался Hydrazine, Сэм никогда не сообщал. Да и верить его словам не лучшая затея.

Например, незадолго до продажи Loopt он говорил, что у сервиса сотни тысяч активных пользователей и общая аудитория в 4 млн. Тогда как сторонние источники говорили о всего 500 ежедневно активных пользователях.

Еще во время работы над Loopt Сэм Альтман параллельно работал в Y Combinator и подружился с Полом Грэмом. Тот в итоге счел, что именно Сэм должен стать новым президентом YC, сменив на этом посту самого Пола Грэма. Это и случилось в 2014 году.

Для Сэма Альтмана это стало не только первой работой в крупной компании, но и возможностью завести знакомства со всеми видными деятелями Кремниевой долины. И этой возможностью он воспользовался.

Как новая версия OpenAI может повлиять на рынок искусственного интеллекта

Сообщения о том, что OpenAI готовится представить первую модель общего искусственного интеллекта (AGI), появились на фоне слухов о разработке Orion . В отличие от предшественников — GPT-4o и o1 — она изначально не будет широкодоступной через ChatGPT, а доступ к ИИ получат компании-партнеры.

Внутри OpenAI рассматривают новую ИИ-модель как преемницу GPT-4, и возможно, официально она будет называться GPT-5. В сентябре руководитель OpenAI Шон Ралстон сообщил, что Orion потенциально в 100 раз мощнее GPT-4. Однако в будущем ее объединят с моделью рассуждений o1 и другими большими языковыми моделями, чтобы создать более эффективную систему, которую будет можно назвать общим искусственным интеллектом (artificial general intelligence, AGI), говорят источники. OpenAI представила модель o1 в сентябре. По данным разработчиков, она отвечает на запросы и сложные задачи на уровне знаний доктора наук точных дисциплин.

На скорый выход AGI намекнул и глава OpenAI Сэм Альтман. В своем манифесте «Век интеллекта», который вышел в сентябре, он написал: «Вполне возможно, что через несколько тысяч дней (!) у нас появится суперинтеллект; это может занять больше времени, но я уверен, что мы доберемся до цели».

Позднее Альтман заявил, что AGI стоит ожидать уже в 2025-м. Сейчас, по его словам, OpenAI активно стремится к разработке общего ИИ, и достичь этой цели можно с помощью текущего оборудования. «Я думаю, что через пять лет, похоже, у нас будет невероятно быстрый темп совершенствования самой технологии. Люди говорят: «Боже, момент AGI пришел и ушел». Темпы прогресса просто сумасшедшие, и мы делаем новые открытия как в сфере ИИ и исследованиях, так и обо всей остальной науке», — отметил Альтман.

Косвенно на скорый выход модели ИИ общего назначения намекает и возвращение в OpenAI сооснователя Грега Брокмана . Он уже работает вместе с генеральным директором Сэмом Альтманом над созданием новой должности, которая будет сосредоточена на решении «значимых технических задач». Летом 2024 года Брокман ушел в творческий отпуск, но сразу объявил о намерении вернуться. «Миссия еще не завершена; нам предстоит создать безопасный ИИ», — написал он в соцсети X. Теперь Брокман отметил : «Самый долгий отпуск в моей жизни завершен. Возвращаюсь, чтобы продолжать строить OpenAI».

В чем заключаются основные различия между новым OpenAI и предыдущими версиями

Издания Financial Times (FT) и Bloomberg сообщили, что инвесторы OpenAI просят совет директоров рассмотреть вопрос о возвращении на должность уволенного гендиректора компании Сэма Альтмана.

«Совет директоров компании получил сотни обращений от инвесторов. Кроме того, ведущий инвестор компании, глава Microsoft Сатья Наделла выразил возмущение по поводу этого решения. Оно вызвало протесты и среди ученых, отвечающих за разработку ChatGPT»,— отмечают собеседники FT, знакомые с ситуацией. По данным источников Bloomberg, возвращение господина Альтмана на должность гендиректора будет возможно лишь в случае «масштабных кадровых и организационных изменений в компании, в результате которых ряд топ-менеджеров лишится своих должностей».

Как утверждает The Verge , OpenAI уже проводит переговоры о возвращении господина Альтмана на пост CEO. Официального подтверждения этой информации нет.

Об увольнении Сэма Альтмана стало известно 18 ноября, решение об отстранении его от занимаемой должности принял совет директоров OpenAI. В качестве повода для отставки названо то, что глава компании «не был откровенен» при взаимодействии с советом. Исполнять обязанности гендиректора временно будет директор по технологиям компании Мира Мурати, однако совет директоров OpenAI уже начал поиск кандидатов на должность гендиректора на постоянной основе.

Сэм Альтман был одним из основателей OpenAI. Он возглавлял компанию с 2020 года. Ранее был главой бизнес-инкубатора Y Combinator.

Компания OpenAI была создана в 2015 году. Занимается изучением искусственного интеллекта. Наиболее известна созданием нескольких поколений языковой модели GPT, на которых основан чат-бот ChatGPT.

Как лень Сэма Альтмана отразится на стратегии развития OpenAI

Предлагаем прочитать это краткий, но содержательный список, наполненный ценными идеями от Сэма Альтмана, одного из лидеров компании OpenAI.

Альтман, известный своей ключевой ролью в Y Combinator, одном из ведущих мировых акселераторов стартапов, прошел впечатляющий путь, который привел его к должности в OpenAI. Его работа в YC характеризовалась продуманным подходом к руководству и стремлением взращивать и направлять новые захватывающие инициативы. Обширный опыт Альтмана проявляется в его менторском подходе. Его стратегические идеи внесли значительный вклад в рост и успех стартапов YC. Точка зрения Альтмана — его акцент на человеческом аспекте предпринимательства. Он подчеркивает пользу от сотрудничества с талантливыми людьми и мотивацию, которая возникает при выполнении значимой работы. Он сочетает практический подход к стратегии с пониманием более мягких, но крайне важных аспектов достижения профессионального успеха. Он также подчеркивает важность страсти, связей, стойкости и сосредоточенности на предпринимательском пути. Прочитайте этот список и выделите то, что будет полезным для вас.

- Оптимизм, одержимость, вера в свои силы, живая энергичность и личные связи — вот с чего все начинается.

- Сплоченные команды, правильное сочетание спокойствия и спешки, а также невероятная самоотдача доводят дела до конца. Ориентация на долгосрочную перспективу в дефиците; важно не беспокоиться о том, что думают люди в краткосрочной перспективе — со временем это станет проще.

- Команде легче сделать трудное дело, которое действительно важно, чем легкое, которое на самом деле не имеет значения; смелые идеи мотивируют людей.

- Дополнительные поощрения суперэффективных, поэтому распределяйте их с осторожностью.

- Сконцентрируйте свои ресурсы на небольшом количестве проектов с высокой вероятностью успеха; это легко сказать, но, очевидно, трудно сделать. Вы можете отказаться от большего количества вещей, чем думаете.

- Общайтесь четко и лаконично.

- Боритесь с чушью и бюрократией каждый раз, когда видите их, и заставляйте других людей бороться с ними. Не позволяйте оргсхеме мешать людям продуктивно работать вместе.

- Главное — это результат; не позволяйте хорошему процессу оправдывать плохие результаты.

- Уделяйте больше времени подбору персонала. Рискните, сделав ставку на людей с высоким потенциалом и быстрыми темпами развития. Помимо интеллекта, ищите доказательства того, что сотрудник умеет добиваться результата.

- Суперзвезды еще более ценны, чем кажется, но вы должны оценивать людей по их суммарному влиянию на эффективность работы организации.

- Быстрое повторение процесса с начала может многое исправить; как правило, если вы заложите такую возможность в планы, ошибиться будет не страшно. Планы должны измеряться десятилетиями, их выполнение — неделями.

- Не боритесь с бизнес-эквивалентом законов физики.

- Вдохновение скоротечно, а жизнь проходит быстро. Бездействие — особенно коварный вид риска.

- Масштабирование часто дает самые непредсказуемые новые эффекты.

- Экспоненциальный рост — это магия. Нужно строить бизнес, который будет получать все большее преимущество при масштабировании.

- Поднимайтесь и продолжайте идти вперед.

- Работа с замечательными людьми — одна из лучших сторон жизни.

Каковы ожидания от новой команды, которую нанял Сэм Альтман

Новый гендиректор OpenAI Эммет Шир уже раскритиковал увольнение Сэма Альтмана, заявив, что оно было «очень плохо организовано» и «серьезно подорвало доверие» внутри компании. Действительно, едва ли можно считать полезным для компании шквал заголовков со словами «шок», «хаос» и «неожиданность», не говоря уже о последовавшим за этим набором противоречивых сообщений. CNBC пишет , что внезапное увольнение Альтмана стало потрясением для Кремниевой долины и «заставило представителей технологического сообщества беспокоиться о будущем ИИ». «Это безответственно и несправедливо по отношению к Сэму и Грегу и всем, кто участвовал в создании OpenAI» — так охарактеризовал случившееся 17 ноября венчурный инвестор Рон Конвей.

Кроме того, обсуждение увольнения Альтмана и его возможных причин вновь актуализировало тему безопасности разработок сильного искусственного интеллекта и противостояния между технооптимистами и так называемыми думерами — людьми, опасающимися вызванного слишком умным искусственным разумом конца света (doomsday). На стороне технооптимистов выступил, в частности, один из самых успешных венчурных инвесторов Марк Андриссен из Andreessen Horowitz, который обвиняет в случившемся думеров из движения эффективного альтруизма. Еще один звездный инвестор Кремниевой долины, Дэвид Сэкс, написал , что Сэм должен вернуться, а в совете директоров вместо представителей некоммерческой организации должны быть инвесторы и основатели, которые разбираются в бизнесе.

Александр Горный считает, что одним из последствий развернувшейся у всех на глазах в эти выходные корпоративной драмы станет то, что «независимых директоров и экзотических структур владения в стартапах теперь станет меньше». Он полагает, что этот урок для основателей и инвесторов не пройдет бесследно — они точно учтут этот урок. Что касается самой компании, говорит Горный, ей это гарантированно будет стоить нескольких потерянных месяцев развития. «Люди уходят вслед за Альтманом — кто-то ушел бы, и если бы Альтман вернулся, мотивация команды в любом случае была бы подорвана, — говорит он. — Дальше компания, скорее всего, оправится. А вот насколько видение Альтмана было определяющим для долгосрочного развития — мы узнаем только спустя годы. Когда Джобс ушел из Apple, это привело к катастрофе. Когда Джобс умер, Apple темпа не потеряла».

«Здоровые компании, возглавляемые компетентными, коммерчески успешными и всемирно любимыми фаундерами, обычно их не увольняют», — отмечает Bloomberg. По мнению FT, уход Альтмана «подрывает коммерческий потенциал компании». Во вторник, 21 ноября, стало известно , что инвесторы все еще пытаются вернуть Альтмана и Брокмана в OpenAI, а самый крупный из инвесторов Microsoft концептуально не против такого исхода, но требует, чтобы в таком случае совет директоров ушел в отставку, а система управления была изменена таким образом, чтобы в будущем повторение ситуации, взорвавшей технологический мир в прошедшие выходные, было невозможно. Сотрудники компании тем временем получили служебное письмо о том, что компания ведет «интенсивные переговоры о возможном возвращении ушедших основателей».

«На этом этапе разрешение ситуации может быть каким угодно», — говорит Сергей Марков, который отмечает при этом, что для отрасли ИИ в целом сейчас наиболее узким горлышком является наличие вычислительных ресурсов и квалифицированных специалистов, поэтому лидерам индустрии скорее нужно объединять усилия, максимально исключая дублирование экспериментов.

Переход Альтмана и части команды из OpenAI в Microsoft Кузнецов считает временным решением. «Microsoft остается в инвесторах OpenAI, то есть либо спишет уже понесенные инвестиции, либо будет содержать две конкурирующие команды. К примеру, несколькими годами ранее менее значительный раскол в OpenAI уже привел к появлению компании Antropic, которую щедро проинвестировал Google. С точки зрения рынка это хорошая новость, конкуренция всегда во благо. С точки зрения создания «сильного ИИ» — сказать сложно, корпоративные нормы и правила куда жестче стартаперских, а в офис Сатьи Наделлы куда проще позвонить из Вашингтона с настойчивой просьбой, чем в абстрактную тусовку эффективных альтруистов».

В целом, по мнению Маркова, скандал в OpenAI привлечет в еще большей мере внимание общества, инвесторов и политиков к развитию технологий ИИ. «Тот факт, что возникший корпоративный конфликт мгновенно стал едва ли не главной мировой новостью, говорит о том, какое исключительное внимание сегодня уделяется развитию технологий искусственного интеллекта, — говорит эксперт. — Такое внимание, скорее всего, приведет к еще большему росту инвестиций в ИИ, но, к сожалению или к счастью, деньги здесь не в состоянии решить многие стоящие перед исследователями и индустрией проблемы, начиная от дефицита людей и вычислительных мощностей и заканчивая проблемами регулирования сферы ИИ и вопросов, связанных с социально ответственным применением этих технологий».

Может ли лень быть полезной качеством для руководителя, как это видно на примере Сэма Альтмана

В ноябре гендиректора OpenAI Сэма Альтмана уволили с поста. Так решил совет директоров компании, который посчитал, что топ-менеджер «был недостаточно откровенен c руководством».

Следом за Альтманом из OpenAI ушли соучредитель OpenAI Грег Брокман, директор по исследованиям Якуб Пачоцки, руководитель команды рисков ИИ Александр Мадри и исследователь Шимон Сидор.

На следующий день совет директоров начал переговоры с Альтманом о возвращении, однако 20 ноября они закончились провалом.

В тот же день стало известно, что Альтман переходит на работу в Microsoft, где возглавит исследовательскую группу в области искусственного интеллекта. Вместе с ним туда перешел и Брокман. О найме топ-менеджеров объявил гендиректор корпорации Сатья Наделла: «Мы очень рады поделиться новостью, что Сэм Альтман и Грег Брокман вместе с коллегами присоединятся к Microsoft, чтобы возглавить новую передовую исследовательскую группу в области искусственного интеллекта. Мы намерены как можно скорее предоставить им все необходимое для успешной работы».

Сообщалось также, что перед увольнением Альтман общался с инвесторами с Ближнего Востока по поводу финансирования своего нового стартапа по проектированию чипов искусственного интеллекта. Предполагалось, что компания будет конкурировать с самым крупным нынешним поставщиком процессоров — Nvidia, а также будет обеспечивать растущие потребности самой OpenAI.

Уже 22 ноября, после массовой забастовки сотрудников OpenAI, стало известно, что Альтман вновь займет пост гендиректора компании. Сам он заявил: «Я люблю OpenAI, и все, что я делал в последние дни, было направлено на то, чтобы сохранить команду и ее миссию». В компанию вернулся и Брокман, а совет директоров теперь заменят. Наделла одобрил это решение.

Какие задачи стоят перед новой командой OpenAI под руководством Сэма Альтмана

После релиза GPT-4 в сообществе исследователей искусственного интеллекта и машинного обучения разгорелись ожесточенные споры. Связаны они с тем, что OpenAI не поделились практически никакими фактами о модели, ее обучении, и принципах сбора данных. Одни говорят, что компанию давно пора переименовать в ClosedAI, другие – что нужно думать про безопасное развитие технологий, которое не приведет человечество к гибели. Ведь бесконтрольное распространение исходников сложных ИИ-моделей приближает нас к моменту, когда внезапно может «родиться» сильный искусственный интеллект (многократно превосходящий по способностям людей) – а способов его контролировать к этому моменту придумать человечество еще не успеет.

А OpenAI с первого дня своего существования как раз задались целью разработать этот самый сильный искусственный интеллект (AGI, или Artificial General Intelligence). Их миссия – сделать так, чтобы искусственный интеллект приносил пользу всему человечеству, и чтобы все имели равный доступ к создаваемым им благам, без привилегий. Более подробно об этом и других принципах можно прочитать в их уставе . Он, кстати, содержит очень интересную фразу – и она повторяется в отчете по GPT-4, который предоставили вместо детальной статьи: «Если проект, совпадающий с нашими целями и заботящийся о безопасности, приблизится к созданию AGI раньше нас, мы обязуемся прекратить конкурировать с этим проектом и начать помогать ему».

Может показаться странным, что такой подход не предполагает открытости технологий или хотя бы описания процесса исследований. На вопрос, почему OpenAI изменила свой подход к публикациям результатов (ведь раньше-то статьи выходили!), уже упомянутый Илья Суцкевер ответил просто: «Мы были неправы. Если вы, как и мы, верите, что в какой-то момент ИИ станет чрезвычайно, невероятно, мощным – тогда в открытом исходном коде просто нет смысла. Это плохая идея… Я ожидаю, что через несколько лет всем станет совершенно очевидно: публиковать ИИ с открытым исходным кодом – это просто неразумно.»

Многие возразят: «Но это всё слова и лирика, обычное бла-бла со стороны OpenAI, не подкрепленное реальными действиями, а на самом деле они просто хотят больше денег себе в карман!». Но есть как минимум три аргумента в пользу того, что OpenAI здесь пытается действовать искренне.

Во-первых, исследования OpenAI не закрыты вообще для всех: на всём процессе разработки модели компания приглашала различных ученых протестировать модель, чтобы понять, представляет ли она какую-либо угрозу. В том числе, были приглашены исследователи из Alignment Research Center (ARC), которые пытались это выяснить, и поспособствовали добавлению некоторых фильтров в процесс обучения модели. Они проверяли, например, что пока модель не может закачивать себя в интернет и начать там бесконтрольно распространяться.

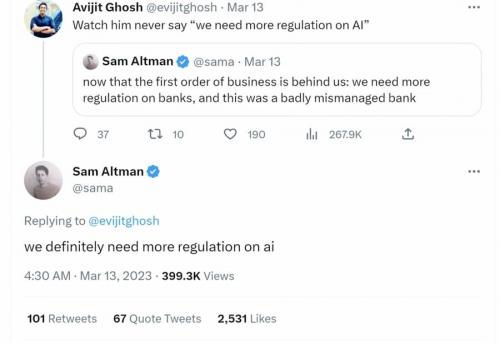

Во-вторых, Сэм Альтман (СЕО OpenAI), публично признает, что в индустрии ИИ нужно больше регуляции, и что они будут работать над этим совместно с сообществом (об этом также прямым текстом пишется в опубликованном отчете по GPT-4):

А третий факт заключается в том, что… модель GPT-4 была уже обучена в августе 2022 года , и в теории могла бы увидеть свет еще в сентябре прошлого года. Но OpenAI потратили лишних 8 месяцев на то, чтобы сделать ее безопаснее, и учесть замечания исследователей. И дело тут совсем не в расистских шутках или в инструкциях по сбору бомб в домашних условиях (и в опасении последующих судебных исков и разбирательств) – вовсе нет. Ведь уже почти три года доступна GPT-3, которая, хоть и глупее, всё равно умеет отвечать на подобное. Добавить чуток фильтров, прописать в правилах условия использования (с ограничением ответственности) – и вроде было бы всё хорошо, можно запускать модель и грести деньги лопатой… Если, конечно, твоя цель действительно выпустить продукт первым и подзаработать, а не обеспечить безопасность разрабатываемого искусственного интеллекта.